作为一名对AI领域充满好奇的探索者,最近我在知乎上刷到了一个非常热门的问题:「AI领域的蒸馏是什么意思?」说实话,这个问题让我既兴奋又困惑。于是,我决定深入研究一下这个话题,并以我的视角为大家解读这一复杂的概念。

什么是模型蒸馏?

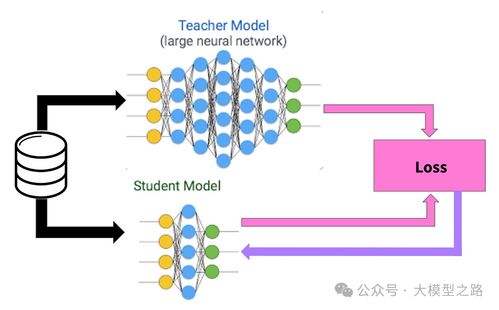

简单来说,模型蒸馏(Model Distillation)是一种将复杂的大模型压缩成更小、更快的小模型的技术。想象一下,大模型就像是一位知识渊博但行动迟缓的教授,而通过蒸馏技术,我们可以把这些知识提炼出来,传递给一位年轻敏捷的学生。这样,这位学生就能快速高效地完成任务,同时还能保持较高的准确性。

苹果公司近期在人工智能领域的研究成果,为蒸馏以及小模型的训练提供了新的思路。这种技术不仅能够显著提升模型的运行速度,还能降低计算资源的消耗。

为什么蒸馏如此重要?

随着AI技术的飞速发展,大模型变得越来越庞大和复杂。虽然它们在性能上表现优异,但在实际应用中却面临诸多挑战,例如计算成本高昂、部署困难等问题。这就使得蒸馏技术显得尤为重要。

比如,我们熟悉的Claude、豆包、Gemini、Llama3.1等模型,都经过了知识蒸馏的过程。这些模型在保证性能的同时,大幅降低了资源消耗,从而能够在更多场景下得到广泛应用。

蒸馏是否合法?

然而,关于模型蒸馏是否合法的问题,业内一直存在较大的争议。在传统的软件行业中,代码的直接复制被认为是侵犯知识产权的行为。但在AI领域,模型蒸馏的本质是通过学习大模型的知识来生成新的小模型,而不是简单的复制粘贴。

因此,如何界定蒸馏技术的合法性,成为了行业内的一个重要课题。目前,各国法律对此尚未形成统一的标准,这也为相关企业和研究人员带来了不少困扰。

服务型蒸馏训练:一种新的解决方案

为了应对这些挑战,一些创新性的解决方案应运而生。例如,基于EDL(Elastic Deep Learning,弹性深度学习框架)提出的服务型蒸馏训练方案,为模型蒸馏提供了一种全新的思路。

这种方案通过优化训练流程,使得模型能够在更短的时间内完成蒸馏过程,同时还能保持较高的精度。这无疑为AI技术的进一步发展注入了新的活力。

总结

总的来说,模型蒸馏是一项极具潜力的技术,它不仅能够帮助我们解决大模型带来的种种问题,还为AI技术的普及和应用开辟了新的道路。作为一名普通的学习者,我对这项技术充满了期待,也希望未来能有更多的人加入到这个领域,共同推动AI技术的发展。

发表评论 取消回复