。通过观察这些标签的class属性,我可以快速定位到需要提取的数据字段,比如歌名、歌手和专辑信息。

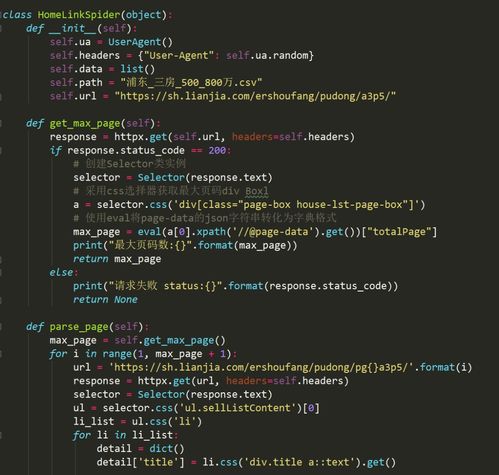

第二步:编写爬虫代码

接下来就是实际动手的部分了。我先写了一个简单的函数,用于发送GET请求并获取网页内容:

import requests

from fake_useragent import UserAgent

def fetch_page(url):

headers = {'User-Agent': UserAgent().random}

response = requests.get(url, headers=headers)

return response.text

这个函数的作用是从指定的URL地址获取网页内容,并随机生成一个用户代理字符串,以降低被封禁的风险。

然后,我使用BeautifulSoup库来解析返回的HTML内容:

from bs4 import BeautifulSoup

def parse_html(html):

soup = BeautifulSoup(html, 'html.parser')

songs = []

for item in soup.find_all('div', class_='song-item'):

title = item.find('a', class_='song-title').text.strip()

artist = item.find('span', class_='artist-name').text.strip()

album = item.find('span', class_='album-name').text.strip()

songs.append({'title': title, 'artist': artist, 'album': album})

return songs

这段代码的核心逻辑是遍历所有包含歌曲信息的

标签,并从中提取出歌名、歌手和专辑等关键信息。

第三步:保存数据

最后一步是将爬取到的数据保存到本地文件中。我选择了CSV格式,因为它简单易读且便于后续分析。以下是实现这一功能的代码片段:

import pandas as pd

def save_to_csv(data, filename):

df = pd.DataFrame(data)

df.to_csv(filename, index=False, encoding='utf-8-sig')

通过调用save_to_csv函数,我可以轻松地将歌曲列表导出为CSV文件。

总结与反思

这次爬虫实践让我深刻体会到了Python的强大之处。它不仅可以帮助我们高效地完成任务,还能让我们在学习过程中收获乐趣。当然,在实际操作中,我也遇到了一些问题,比如反爬机制和数据清洗等。但正是这些问题促使我去寻找解决方案,从而不断提升自己的技术水平。

如果你也对Python爬虫感兴趣,不妨试着动手做一做吧!相信你会从中发现更多意想不到的乐趣。

发表评论 取消回复