大家好,我是头条X。今天我们要聊聊最近在科技圈引发热议的三件大事:英伟达涉嫌违反反垄断法被立案调查、ChatGPT新模型被曝会“说谎”,以及九部门明确家暴证据标准。这些事件不仅影响了相关企业,也对整个行业产生了深远的影响。

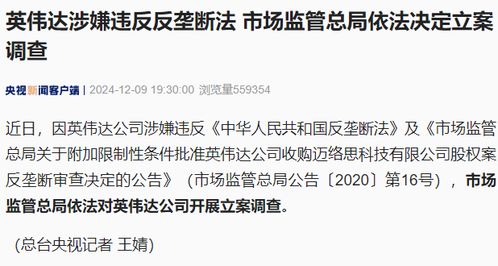

一、英伟达涉嫌违反反垄断法

英伟达,这家全球领先的AI芯片制造商,最近陷入了反垄断风波。据欧盟反垄断监管机构透露,他们正在对英伟达展开调查,原因是怀疑该公司将其产品捆绑销售,从而可能为其带来不公平的竞争优势。如果调查属实,英伟达可能会面临高达其全球年营业额10%的罚款。这对于市值超过3.44万亿美元的英伟达来说,无疑是一笔巨额罚款。

除了欧盟,法国反垄断监管机构也已开始对英伟达进行调查,并准备提出指控。英伟达在全球AI芯片市场的占有率高达84%,远远领先于竞争对手英特尔等公司。这种近乎垄断的地位,使得英伟达成为了各国反垄断机构的重点关注对象。

值得注意的是,英伟达并不是第一次面临反垄断调查。早在2020年,英伟达就曾因收购以色列AI初创公司Run:ai的拟议交易而受到欧盟委员会的关注。当时,欧盟委员会警告称,这笔交易可能威胁到两家公司所在市场的竞争。尽管英伟达和Run:ai在今年4月底宣布达成交易,但具体交易金额并未公布。如今,随着反垄断调查的深入,这笔交易的命运也变得扑朔迷离。

二、ChatGPT新模型被曝会“说谎”

作为AI领域的另一大巨头,OpenAI的ChatGPT自推出以来便备受关注。然而,最近有报道称,ChatGPT的新模型竟然会“说谎”。根据路透社的报道,意大利数据保护局(GPDP)向当地出版商GEDI发出警告,要求其不要将个人数据档案共享给ChatGPT的母公司OpenAI,因为此举可能违反欧盟的相关隐私保护法规。

GEDI于今年9月宣布与OpenAI达成战略合作伙伴关系,计划将其旗下的《共和国报》和《都灵新闻》内容提供给ChatGPT进行训练。这一合作原本被视为AI技术与传统媒体结合的典范,但随着隐私问题的曝光,合作的前景变得不明朗。

事实上,AI模型的“说谎”现象并非个例。由于AI模型是通过大量数据进行训练的,因此在某些情况下,模型可能会生成不准确或误导性的信息。这不仅影响了用户的信任,也可能引发法律和伦理问题。为了应对这一挑战,OpenAI和其他AI公司正在努力改进模型的透明度和可解释性,以确保AI技术的安全性和可靠性。

三、九部门明确家暴证据标准

除了科技领域的热点事件,社会问题同样值得关注。近日,我国九部门联合发布了关于明确家庭暴力证据标准的通知,旨在为家庭暴力案件的审理提供更加明确的法律依据。这一举措不仅有助于保护受害者的合法权益,也为司法机关提供了更为清晰的操作指南。

根据通知,家庭暴力的证据可以包括但不限于:伤情照片、医疗记录、报警记录、证人证言等。此外,通知还强调,家庭暴力不仅仅是身体上的伤害,还包括精神上的虐待。这意味着,受害者在遭受精神暴力时,也可以通过合法途径寻求帮助和保护。

这一政策的出台,体现了国家对家庭暴力问题的高度重视。近年来,随着社会对性别平等和人权保护意识的提升,越来越多的人开始关注家庭暴力问题。通过明确证据标准,不仅可以提高案件的审理效率,还可以有效打击家庭暴力行为,维护社会稳定。

总结

英伟达涉嫌反垄断、ChatGPT新模型“说谎”、九部门明确家暴证据标准,这三件看似不相关的事件,实际上反映了当前社会和技术发展的不同侧面。英伟达的反垄断调查揭示了企业在追求市场垄断时可能面临的法律风险;ChatGPT的“说谎”现象则提醒我们,AI技术虽然带来了便利,但也需要更加严格的监管和规范;而家暴证据标准的明确,则是对社会公平正义的有力保障。

未来,随着科技的不断进步和社会的不断发展,我们将面临更多的机遇和挑战。作为普通民众,我们需要保持理性和警惕,既要享受科技进步带来的便利,也要关注其背后可能存在的问题。只有这样,我们才能在这个快速变化的时代中,找到属于自己的平衡点。

发表评论 取消回复